«Цифровые военные манёвры» в Луизиане.

«Цифровые военные манёвры» в Луизиане.Американская гонка технологий ИИ: кто не успел, тот потерял

«Цифровые военные манёвры» в Луизиане.

«Цифровые военные манёвры» в Луизиане.Проекты национальной стратегии ИИ США

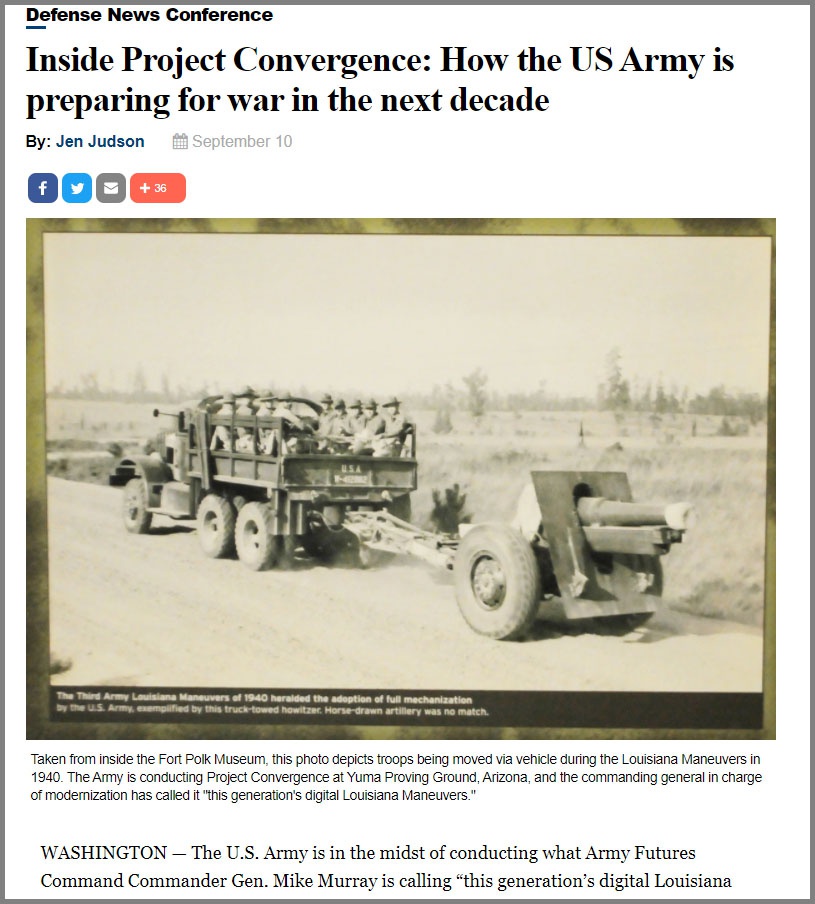

10 сентября медиаресурс Defence News опубликовал статью Inside Project Convergence: How the US Army is preparing for war in the next decade («Внутри проекта "Конвергенция": как армия США готовится к войне в следующем десятилетии»), в которой генерал армии Майк Мюррей, проводивший «цифровые военные манёвры» в Луизиане, поделился своими мыслями о войне будущего в сравнении со Второй мировой войной.

В частности, генерал Мюррей отметил, что германские войска одерживали победу благодаря сочетанию трёх технологий - самолётов, танков и радиосвязи (разведке): «Это было сочетание трёх технологий и того, как немцы объединили их, чтобы выполнить то, что мы называем блицкригом». При этом Мюррей сказал, что в 2020 году существуют три ключевые технологии, которые, в сочетании с другими, обеспечат преимущество армии США против равных по силе противников - это искусственный интеллект (ИИ), автономность, воздушная и наземная робототехника.

«Чтобы заставить эти три системы работать в цифровой среде, вы должны иметь базовую надёжную и устойчивую сеть, - сказал Майк Мюррей, - и у вас должна быть архитектура данных, данные и талант, чтобы собрать всё это воедино». Именно в этом состояла основная задача, которую отрабатывали американские военнослужащие во время «цифровых военных манёвров» в Луизиане.

Статья Inside Project Convergence: How the US Army is preparing for war in the next decade на медиаресурсе Defence News.

Статья Inside Project Convergence: How the US Army is preparing for war in the next decade на медиаресурсе Defence News.Данные манёвры выполнялись в рамках проекта «Конвергенция» (Project Convergence), составной части концепции Multidomain Operations (MDO), которая имеет три составные фазы:

1. Проникновение и нейтрализация дальнобойных систем вооружения противника, борьба с манёвренными силами противника с оперативных и стратегических дистанций.

2. Дезинтеграция систем обороны противника входящих в зону воспрещения доступа и манёвра (A2AD). Выведение из строя систем вооружения дальнего и ближнего радиуса действия противника при проведении самостоятельных манёвренных и дезинформационных операций.

3. Использование свободы манёвра для поражения целей и сил противника.

В качестве основных средств вооружения, позволяющих выполнить боевые задачи трёх фаз, будут привлекаться - Future Attack Reconnaissance Aircraft (будущий ударный разведывательный самолёт), Future Long-Range Assault Aircraft (будущий дальний штурмовик) и Extended Range Cannon Artillery system (артиллерийская система расширенной дальности).

Предполагается, что все эти комплексы вооружения будущего смогут взаимодействовать с наземными станциями из программы «ТИТАН» (program TITAN), которые с использованием искусственного интеллекта обрабатывают целевую информацию с автономных наземных и воздушных средств разведки. Комплексы TITAN управляются батальоном разведки, информации, кибернетики, радиоэлектронной борьбы и космоса (I2CEWS) многодоменной оперативной группы армии (база Льюис Маккорд, штат Вашингтон).

Проект «Конвергенция» и проект «Защитник» (Project Quarterback - автоматическое распознавание целей с помощью искусственного интеллекта [ИИ/AI] для боевых машин будущего), по словам генерала Мюррея, являются первыми тестами направленными на объединение интегрированной системы боевого командования (Integrated Battle Command System, IBCS) и будущей системы командования и управления систем ПВО и ПРО Армии США (Future Air-and-Missile Defense System, FAMDS). К слову сказать, эти два проекта лишь часть остальных - 600 активных проектов, связанных с технологией ИИ разрабатываемых по заказу Пентагона.

По информации Исследовательской службы Конгресса США, на проекты в рамках национальной стратегии Artificial intelligence. Strategy. Using AI to promote our security and prosperity («Искусственный интеллект. Стратегия. Использование ИИ для продвижения нашей безопасности и процветания») Пентагон готов потратить свыше 13 млрд долларов до конца 2021 года, и эти затраты не окончательные.

Пентагон готов потратить свыше $13 млрд до конца 2021 года на проекты в рамках национальной стратегии «Искусственный интеллект. Стратегия. Использование ИИ для продвижения нашей безопасности и процветания».

Пентагон готов потратить свыше $13 млрд до конца 2021 года на проекты в рамках национальной стратегии «Искусственный интеллект. Стратегия. Использование ИИ для продвижения нашей безопасности и процветания».Риски и возможности ИИ в интересах нацбезопасности США

Я не случайно упомянул Исследовательскую службу Конгресса (Congressional Research Service. CRS). Дело в том, что эта служба в августе 2020 года опубликовала аналитический отчёт Artificial Intelligence and National Security («Искусственный интеллект и национальная безопасность»), в котором рассмотрела все работы связанные с ИИ, в том числе в России и Китае, оценила риски реализации и выдала рекомендации.

В начале отчёта CRS даёт обоснование того, почему США стали вести активные работы по технологии ИИ в интересах национальной безопасности. Оказывается - это ответ на стратегию Китая, который в 2017 году объявил о своих намерениях стать мировым лидером в области ИИ, а также реакция на слова президента России Владимира Путина, который сказал: «Мы станем лидерами в этой области и будем править миром!»

Видимо в США совсем плохо со знанием русского языка, раз авторитетная CRS искажает слова нашего президента, который на самом деле сказал иначе.

Цитата

«Искусственный интеллект - это будущее не только России, это будущее всего человечества. Здесь колоссальные возможности и трудно прогнозируемые сегодня угрозы. Тот, кто станет лидером в этой сфере, будет властелином мира. И очень бы не хотелось, чтобы эта монополия была сосредоточена в чьих-то конкретных руках, поэтому мы, если мы будем лидерами в этой сфере, также будем делиться этими технологиями со всем миром, как мы сегодня делимся атомными технологиями, ядерными технологиями».

Президент РФ В.В. Путин в разговоре по телемосту со школьниками из Бурятии в ходе проходившего в Ярославле открытого урока «Россия, устремлённая в будущее». 1.09.2017.

«Искусственный интеллект - это будущее не только России, это будущее всего человечества», - заявил 1 сентября 2017 года Владимир Путин на Всероссийском открытом уроке «Россия, устремлённая в будущее».

«Искусственный интеллект - это будущее не только России, это будущее всего человечества», - заявил 1 сентября 2017 года Владимир Путин на Всероссийском открытом уроке «Россия, устремлённая в будущее».Его слова сказаны и услышаны. Кстати, помимо Пентагона в «гонке технологии ИИ» участвуют агентства DARPA и IARPA (Агентство разведывательных проектов перспективных исследований), т.е. сумма затрат на овладение технологией ИИ намного выше $13 млрд, но в силу того, что бюджеты агентств находятся под грифом «секретно», мы можем только предполагать, что суммы затрат соизмеримы с тратами Пентагона.

Риски реализации, о которых говорят специалисты CRS, фактически повторяют то, что было изложено в отчёте RAND - The Department of Defense. Posture for Artificial Intelligence. Assessment and Recommendations («Министерство обороны США. Состояние доктрины ИИ. Оценка и рекомендации»). Однако есть и дополнения, изложенные в главе «Возможности и проблемы ИИ», среди которых ключевыми проблемами названы автономность, предсказуемость и объяснимость.

Под проблемой «автономности» специалисты отмечают тот факт, что несмотря на то, что автономные роботизированные системы дают преимущества в тактике и стратегии, существует «моральное обязательство», ограничивающее прогресс этой технологии. «Моральное обязательство» касается летальных автономных систем оружия (LAWS), на которые распространяется директива Министерства обороны США №3000.09 «Автономия в оружейных системах». Директива требует, чтобы все системы, независимо от классификации, были разработаны таким образом, чтобы «автономное оружие всегда оставалось под контролем и управлением человека». Цитируя слова главы Пентагона Марка Эспера, о том, что китайские производители оружия продают автономные дроны, способные наносить смертельные прицельные удары, специалисты CRS предлагают обойти ограничения и продолжить исследования «нелетальных автономных электронных оборонных систем, создаваемых против материальных целей».

Проблема «предсказуемости» связана с тем, что Пентагон хочет создать боевые системы с ИИ на основе гражданских разработок, имеющие один набор данных. В реальном бою набор данных, которыми оперирует ИИ, может существенно отличаться, что приведёт к критическим сбоям. Потому что люди в бою могут совершать ошибки и это будут индивидуальные ошибки, а у боевых систем ИИ такие ошибки могут привести к «крупномасштабным или разрушительным последствиям».

Люди в бою могут совершать ошибки и это будут индивидуальные ошибки, а у боевых систем ИИ такие ошибки могут привести к «крупномасштабным или разрушительным последствиям».

Люди в бою могут совершать ошибки и это будут индивидуальные ошибки, а у боевых систем ИИ такие ошибки могут привести к «крупномасштабным или разрушительным последствиям».Проблема «объяснимости» связана с тем, что люди пока не принимают решения на основе анализа, проведённого ИИ. Она объясняется следующими факторами:

- Согласование целей. У человека и машины должно быть общее понимание цели. Поскольку военные системы сталкиваются с динамикой окружающей среды, цели изменяются, поэтому человек и машина должны приспособиться действовать слаженно на основе общей картины текущего окружения.

- Выравнивание задач. Люди и машины должны понимать границы одного пространства для принятия решения, особенно при изменении целей. В этом процессе люди должны быть полностью осведомлены о конструктивных ограничениях машины для исключения недоверия к системе ИИ.

- Человеко-машинный интерфейс. В связи с необходимостью принятия своевременных решений многие военные приложения ИИ, традиционные машинные интерфейсы могут замедлять производительность, но должен быть способ для человека и машины координировать это в реальном времени, чтобы завоевать «разумное доверие» человека к ИИ.

«Убойные» аргументы конторы CRS

Описывая достижения Китая и России в области технологий ИИ, специалисты CRS дают оценки основанные на известной (добытой) информации. Так, описывая достижения Китая, признаётся тот факт, что китайцы превзошли США по количеству опубликованных научно-исследовательских статей в области технологий ИИ. При этом в отчёте приводятся слова помощника генерального прокурора Джона Деммерса, который утверждает, что «90% дел Минюста были связаны с экономическим шпионажем и кражей коммерческой тайны в интересах Китая». Помимо этого, сообщается, что разработки ИИ в Китае «коррумпированы», разработчики «не опытны», а инвестиции «не эффективны».

Россия создала аналог DARPA - Фонд перспективных исследований.

Россия создала аналог DARPA - Фонд перспективных исследований.Да уж, начали за здравие, а кончили за упокой. Но - подождите улыбаться, т.к. я ещё не рассказал, как американцы оценили Россию. Несмотря на то, что весь мир дрожит от «русских хакеров», которые могут взломать и добыть самые защищаемые секреты США, достижения России в области ИИ, по мнению специалистов из CRS, очень и очень скромные. Перечислю их:

1. Россия создала аналог DARPA - Фонд перспективных исследований, который проводит ежегодную конференцию «Роботизация Вооружённых сил России».

2. Заявление Виктора Бондарева на презентации боевого робота «Нерехта» о том, что этот робот станет «платформой исследований и разработок для ИИ».

3. Разработки робота-танка Т-14 «Армата», а также других беспилотных комплексов с встроенным ИИ.

4. ИИ в комплексах РЭБ.

5. Технологии ИИ для внутренней пропаганды и слежки, а также для информационных операций, направленных против США и её союзников.

Завершает подведение итогов достижений России «убойная» аргументация о том, что у России мало денег на технологию ИИ (бюджет Министерства обороны постоянно сокращается) и российские учёные опубликовали мало исследований по ИИ.

Кратко о такой аналитике: Китай все технологии ворует, а Россия не способна освоить технологию ИИ. Занавес. Продолжительный смех.

Честно говоря, подобные оценки возможности нашего ВПК в разработке военных технологий встречались совершенно недавно. В начале 2018 года аналитики США утверждали, что «страна-бензоколонка с разорванной от санкций экономикой» не может создать высокотехнологичные гиперзвуковые комплексы вооружений. Помните? И я помню.

Российский гиперзвуковой авиационный ракетный комплекс «Кинжал».

Российский гиперзвуковой авиационный ракетный комплекс «Кинжал».Мало того, я помню, что специалисты CRS в сентябре 2019 года в отчёте Hypersonic Weapons: Background and Issues for Congress («Гиперзвуковое оружие: предпосылки и проблемы для конгресса США») вынуждены были признать факт существования гиперзвуковых комплексов «Сармат», «Циркон», «Кинжал» и «Авангард». Последние два уже поступают на вооружение нашей армии, а первые два завершают испытания.

Помимо этого, когда стратегии Пентагона в области ИИ ещё не существовало - «русский ИИ», известный как автоматизированная система управления войсками (АСУВ), проходил обкатку в реальных боевых условиях в Сирийской арабской республике.

К чему это я? А к тому, что как бы специалистам CRS не пришлось в очередной раз наступить на одни и те же грабли. Опасаюсь за их сосуд для мыслей.